文部科学省が示したガイドラインでは、児童生徒に Chat GPT などの生成AIを使わせる際は、事前指導が必要との見解が示されています。

▼ガイドラインの解説記事▼

ガイドラインで、事前の指導内容のひとつとして記載されているのがファクトチェック(事実確認)です。

この記事では、以下の内容を解説していきます。学校での指導の参考になれば幸いです。

- ファクトチェックとは何か

- ファクトチェックの必要性

- ファクトチェックの方法

- ファクトチェックの指導方法

ファクトチェックとは

ファクトチェックとは、生成AIによって出力された回答が正しいかを判断することです。

文部科学省のガイドラインでは、ファクトチェックは生成AIの活用を学ぶ第2段階に位置付けられています。

- 生成AI自体を学ぶ段階(生成AIの仕組み、利便性・リスク、留意点)

- 使い方を学ぶ段階(より良い回答を引き出すためのAIとの対話スキル、ファクトチェックの方法等)

- 各教科等の学びにおいて積極的に用いる段階

- 日常使いする段階(検索エンジンと同様に普段使いする)

ちなみに、文部科学省のガイドラインについては、別の記事で解説しています。

ファクトチェックの必要性

Chat GPT をはじめとする生成AIは誤った情報を出力することも多いです。

生成AIはある単語や文章の次に来る単語や文章を推測し、「統計的にそれらしい応答」を生成するものです。そのため、生成AIには内容が正しいかどうかの判断がつきません。

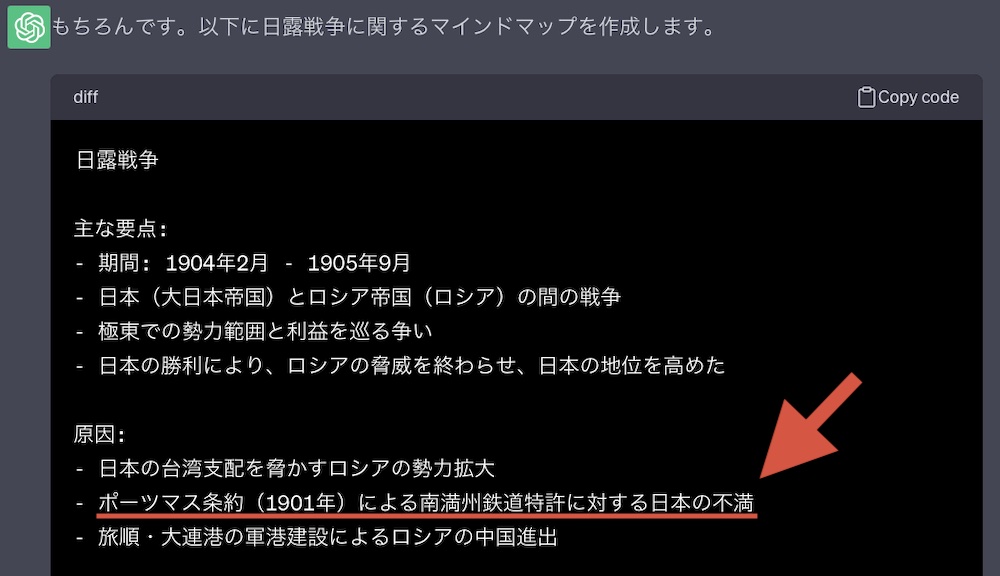

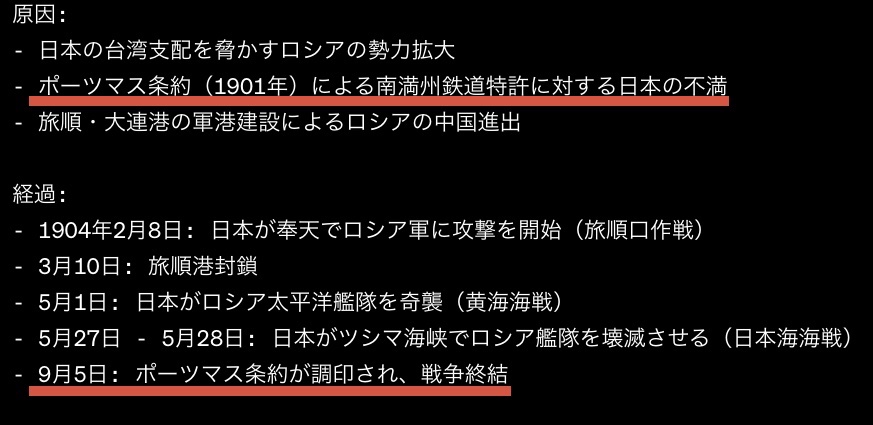

例えば、Chat GPT に日露戦争についてマインドマップを作成するよう指示したところ、次のように誤りが含まれていました。

Chat GPT の回答では「ポーツマス条約(1901年)による南満州鉄道特許に対する日本の不満」と記載されていますが、ポーツマス条約は1905年に結ばれた講和条約なのでこれは誤りです。

生成AI、特に無料版の Chat GPT はわりと頻繁に間違った情報を出力するので、ご自分の教科でも試してみることをおすすめします。

ファクトチェックの方法

生成AIの特性を知り、情報を疑う

生成AIは事実と全く異なる内容や、文脈と無関係な内容などが出力されることもあります。これは幻覚(ハルシネーション Hallucination)と言われます。

また、生成AIは、全くもって間違っている時でも、自信たっぷりにそれらしい文章を生成します。人間のように自信のなさを表すことはありませんが、誤りが含まれている可能性は常にあります。

生成AIが出力する情報には常に誤りが含まれていると考え、疑う習慣を持つことが第一歩です。

文章の論理性や一貫性をチェックする

生成AIの生成する文章は、論理性に乏しかったり、一貫性が失われていることがあります。

例えば、日露戦争についてマインドマップを作成させたところ、ポーツマス条約が開戦原因と戦争終結部で2回記載されていました。史実を知らなくとも、どちらかが誤りであることが推測できます。

生成AIによる回答を読んで、おかしいと思ったところ、わからないことは自分で調べる習慣をつけることが重要です。

複数の情報源に当たる

生成AIを専門分野以外で利用する場合は、複数の情報源に当たることが欠かせません。

その上で、信頼できるソースと比較する必要があります。情報源について確認するとともに、他者から認められているかどうか、どの程度ピアレビュー(有識者による相互評価)が機能しているか考えることが大切です。

情報源の例と信頼性

- 学術論文:学術論文は、専門家によって査読されたものであり、信頼性が高いとされています。

- 政府機関の発表:政府機関から発表された情報は、信頼性が高いとされています。

- 新聞:新聞は、事実を報道することが求められており、信頼性が高いとされています。ただし、一部の新聞社には偏向報道が指摘されている場合もあります。

- テレビ:テレビは、ニュース番組などで事実を報道することが求められており、信頼性が高いとされています。ただし、一部の番組には偏向報道が指摘されている場合もあります。また、日本ではテレビを信頼できる情報源とする人が7割を超えますが、諸外国においては5割程度にとどまります。

- インターネット記事:インターネット記事は、誰でも投稿できるため、信頼性が低い場合があります。そのため、投稿者や引用元のユーザー名を確認し、引用された情報が正確であるかどうかを確認することが重要です。

- SNS:SNSは、誰でも投稿できるため、信頼性が低い場合があります。そのため、投稿者や引用元のユーザー名を確認し、引用された情報が正確であるかどうかを確認することが重要です。

ファクトチェックの指導方法

生成AIも間違うことを理解させる

先述のように、生成AIは誤った回答でももっともらしく出力します。一見すると説得力があるように見えても、実際には誤りが含まれていることを児童生徒にも体感させましょう。

そのためには、児童生徒でもはっきりとわかるような生成AIの間違いを提示することが効果的です。

生成AI(Chat GPT)の誤回答は別の記事にまとめています。出来るだけ児童生徒にもわかるような事例を教科別に記載しています。

複数の情報源をチェックさせる

生成AIを利用する際は、複数の情報源を確認する習慣が必要です。信頼できる情報源の見分け方についても指導しましょう。

なお、生成AIのうち、Bing Chat や Google Bard はインターネット上の情報を参照して回答を作成します。

その場合、インターネット上の情報と比較してもあまり意味はありませんので注意しましょう。

間違い探しゲームで情報リテラシーを高める

ファクトチェックを指導する上で、オススメの活動は間違い探しゲームです。

Chat GPT など生成AIが出力した文章に含まれる間違いを制限時間内にできるだけ多く見つけるよう指示します。

児童生徒でチームを作って対抗戦にすると盛り上がるかもしれません。

実際に自分でやってみることで、知識だけでなく、生成AIの出力する情報を疑ったり、真偽を確かめるスキルが高まることが期待できます。