一般的に、チャットGPTなど生成AIは、労働生産性の向上やコスト削減といったメリットがあるとされます。

一方で、情報漏洩のリスクや責任の所在、リスクマネジメントの難しさが課題とされていますが、教育分野ではどうなのか気になりますよね。

この記事では、学校教育に的を絞って、チャットGPT (生成AI) のメリットとデメリットを解説していきます。

チャットGPT (生成AI) のメリット

チャットGPTのメリットは、次の6つです。

- 教育成果の向上

- 教育の個別化

- 教育コストの削減とリソース配分

- IT活用能力の育成

- 教育機会の保障

- 外国語学習の促進

1. 教育成果の向上

チャットGPT を用いることで、教育成果の向上が期待できます。

生成AIは、児童生徒の個別の疑問に対して、すぐに人間のような返答を返すことが可能なので、授業や教科書でわからないことを教えてくれる家庭教師の役割が期待できます。

参考書やインターネットなどあらかじめ書かれた情報では学習が難しいという児童生徒も多くいます。

対話形式で学習を進められることで、学習内容をよりよく理解できる生徒が増えることが期待されます。

2. 教育の個別化

チャットGPTを用いることで、児童生徒ひとりひとりに応じた指導が可能になります。

学習状況や興味関心といったニーズに応じて、問題のレベルや学習計画などを生成することができ、児童生徒が自分のペースで進めることができるようになります。

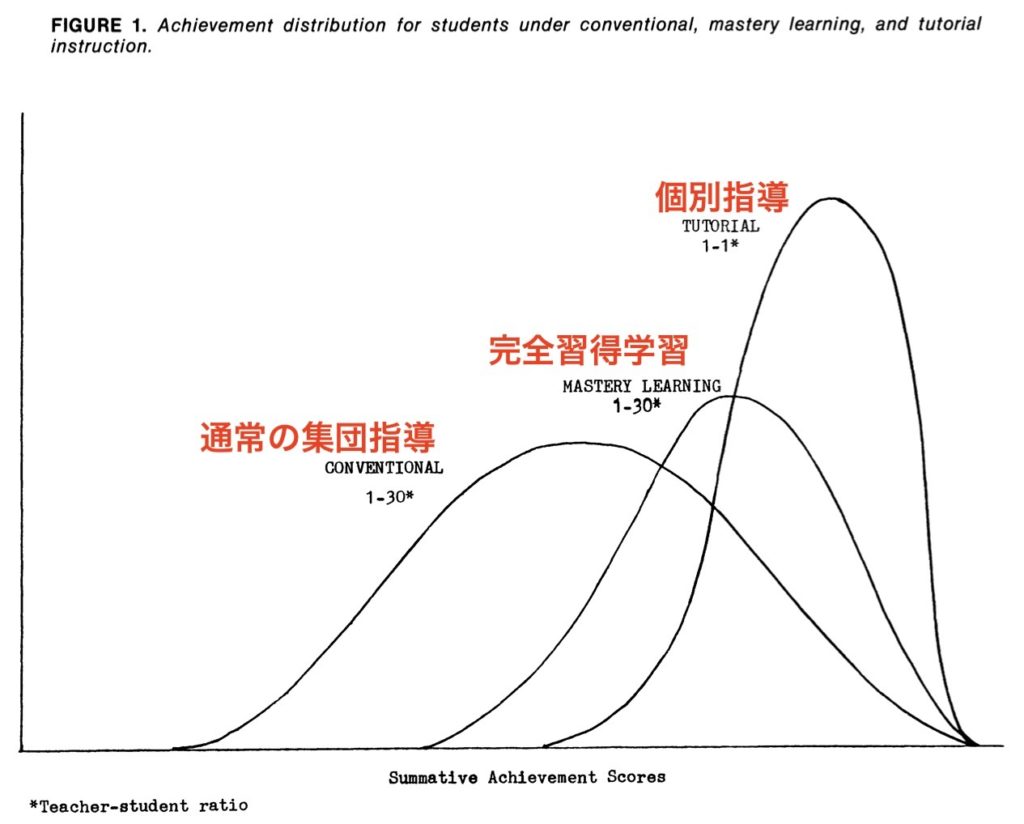

ブルーム(1984)では、個別指導の重要性を主張しています。実験では、個別指導を受けた98%の生徒が、通常の集団指導を受けた生徒の平均成績よりも高い成績を出したとしています。

98%という数字の正確性は議論の対象となっているものの、個別指導より効果的な指導法が見つかっていないのも事実です。

人間による個別指導は費用がかかりすぎてしまいますが、生成AIであれば可能かもしれません。

3. 教育コストの削減とリソース配分

授業準備や考査作成など、これまで教師が担ってきた業務の一部はチャットGPTで代替が可能です。

また、時間割の作成や文書作成など、チャットGPTを使うことで効率化が図れる業務も多いです。

教師が短時間で授業準備ができるようになれば、その分、児童生徒の指導に費やせる時間が増えます。

4. IT活用能力の育成

文部科学省のガイドラインにおいて重視されている項目のひとつが「情報活用能力」です。

情報技術を学習や日常生活に活用できるようにすることが重要であり、生成AIについても近い将来に使いこなすための力を意識的に育てていくことが重要であるとしています。

児童生徒が学校外でスマートフォンなどから生成AIを使う可能性も十分にあります。

生成AIをどのように使いこなしていくのか、情報モラルや偽情報にどう対処していくのか、ファクトチェックも含めて指導することが重要です。

文部科学省のガイドラインは、別の記事で解説しています。

5. 教育機会の保障

生成AIは、地理的制約や経済的制約を超えて利用することが可能です。

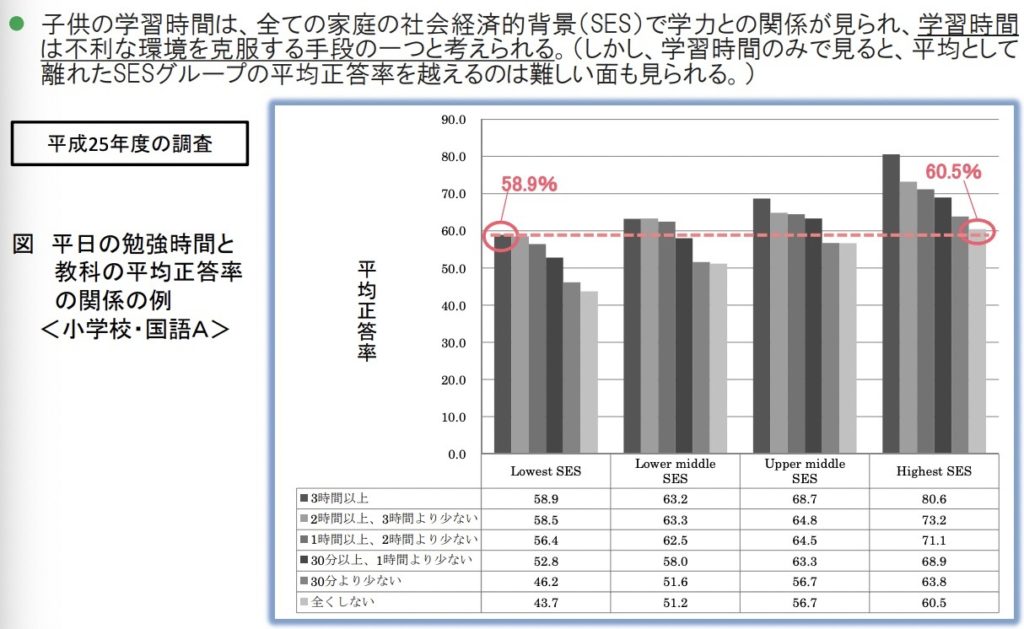

文部科学省の調査では、保護者の経済力や学歴が高い児童生徒の方が学力が高いことが指摘されています。

しかも、不利な状況の児童生徒が学習時間を増やしたとしても、経済的に恵まれている層に追いつくことはありません。

格差を縮小するには、経済的に不利な児童生徒にも学校外における教育機会を与える必要があります。

チャットGPTなど生成AIのサービスには無料で利用できるものが多いことから、格差縮小につながることが期待されています。

6. 外国語学習の促進

チャットGPTは言語処理に優れています。英作文の添削も出来ます。生成AIを講師として英会話を行うことも可能です。

対面式の英会話と違い費用もかかりませんし、人前で英語を話すプレッシャーからも解放されます。

上手に活用できれば、飛躍的に英語力を向上させていくことも可能かもしれません。

チャットGPT (生成AI) のデメリット

チャットGPTのデメリットは、次の6つです。

- 情報の信憑性(偽情報の拡散)

- 思考力・判断力等の低下

- 学習意欲の低下

- 個人情報とセキュリティの問題

- 著作権の侵害

- 格差の問題

1. 情報の信憑性に欠ける

無料版のチャットGPTは、かなりの頻度で誤った情報を出力します(生成AIの誤回答は別の記事にまとめています)

生成AIは、ある単語や文章の次に来る単語や文章を推測し、「統計的にそれらしい応答」を生成するものです。情報の正確さを判断することはできません。

そのため、生成AIの利用者は何が真実であるのか見極める必要があります。これをファクトチェックといいます。

文部科学省のガイドラインでは、生成AIの特徴などと合わせて、ファクトチェックについても指導することとなっています。

ファクトチェックの指導方法は、別の記事で解説しています。

2. 思考力など判断力の低下

チャットGPTは、使い方によっては児童生徒が思考する機会を奪ってしまいます。

文部科学省のガイドラインでは、生成AIを使う前に児童生徒に考える機会を設けるよう求めています。

授業中は対応しやすいですが、授業外には注意が必要です。特に、長期休暇などで読書感想文や自由研究、レポートを提出させる場合は配慮が必要です。

3. 学習意欲の低下

生成AIは、児童生徒の学習意欲や努力を低下させる可能性があります。

生成AIは児童生徒に代わって課題やレポートなどを作成することができます。そのため、自分で考えたり書いたりしなくなる可能性があります。

このような状況を放置すると、生成AIへの依存へとつながります。そうなる前に事前指導を行っていきましょう。

4. 個人情報の侵害とセキュリティ問題

チャットGPTに個人情報を入力すると、入力した情報が学習され、いずれ出力される可能性がゼロではありません。

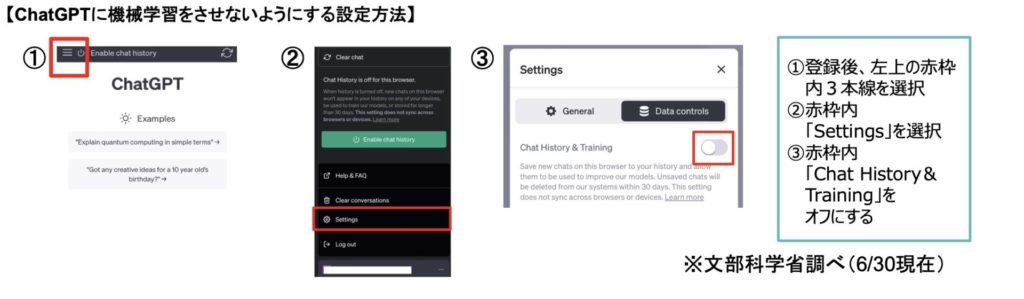

チャットGPTに機械学習させない方法はありますが、そもそも個人情報を入力しないようにしましょう。

また、AIシステムは技術的な問題やエラーが発生する可能性があり、データのセキュリティの問題も懸念されます。

適切なセキュリティ対策が講じられていない場合、学習者や教育機関の情報が漏洩する可能性はゼロではありません。

5. 著作権の侵害

生成AIは既存のデータを元にコンテンツを作成するため、そのデータに含まれる著作物を無断で使用してしまう場合があります。

特に、個人や教育利用を超えて、インターネット上にアップロードする行為は著作物の公衆送信にあたります。

AIを利用した場合でも、著作権侵害については、人間が創作した場合と同様に、オリジナル作品との類似性および依拠性(模倣する意図があったか)によって判断されます。

海外ではすでに訴訟へと発展しているケースもあります。Bing Chatなどは画像生成も可能ですが、インターネットにアップロードする場合は注意しましょう。

なお、生成AIに関する著作権については文化庁が動画と資料を公開しています。

文化庁 令和5年度著作権セミナー「AIと著作権」の講演映像及び講演資料

https://www.bunka.go.jp/seisaku/chosakuken/93903601.html

6. 格差の問題

AIを使用する学校とそうでない学校との間には、技術へのアクセスや教育リソースの格差が生じる可能性があります。

一部の児童生徒はAIを活用することで恩恵を受ける一方、技術にアクセスできない児童生徒は不利な状況に置かれる可能性があります。

チャットGPTには無料版(GPT 3.5)と有料版(GPT 4.0)があり、有料版の方が偽情報が少ないなど高性能です。

このように、チャットGPTはメリットも多いですが、デメリットもあるので、上手に向き合っていく必要があります。

生成AIは諸刃の剣(教育論文まとめ)

生成AIは諸刃の剣です。上手に使えば児童生徒にとっても、教師にとっても大きな味方になってくれますが、使い方を間違えるとデメリットが大きくなります。

W.M. Lim et al. (2023). は、教育分野における生成AIのパラドックスを4つ指摘しています。

パラドックス1

生成AIは「味方」であると同時に「敵」である

生成AIは、正しい情報を、著作権など法的・倫理的な問題なく提供してくれる限り「味方」です。

一方で、誤った情報を出力したり、法的・倫理的に問題のある情報を出力する場合は「敵」となります。

パラドックス2

生成AIは「有能」であるが「利用者次第」である

生成AIは、間違った回答をする場合もありますが、基本的に有能です。こちらが求める答えを即座に返してくれることが多いです。

ですが、生成AIの回答は入力するプロンプト(指示)に依拠しています。そのため、使い手によって価値が大きく変わります。

パラドックス3

生成AIは「利用可能」であると同時に「制約的」である

生成AIは誰もがアクセスできる特徴があります。チャットGPTの開発元であるOpenAIは、自社のミッションを生成型AIが人類全体に利益をもたらすことを確実にすることと述べています。

一方で、生成AIによっては、限られた期間だけ無料で利用できるようになっており、有料のサブスクリプションサービスも含まれている可能性があります。

パラドックス4

生成AIは「禁止」されると余計に「人気」になる

生成AIは便利であるものの、禁止の対象となることも多いです。ですが、正当な理由なく禁止されると、かえってそのことについての興味を高めてしまうという心理効果(ストライサンド効果)があります。

そのため、禁止するよりも、どのように使いこなしていくのかという視点から指導を加えた方が有益である結論づけています。

Reference: Lim, W. M., Gunasekara, A. N., Pallant, J. L., Pallant, J. I., and Pechenkina, E. (2023). Generative AI and the future of education: Ragnarök or reformation? A paradoxical perspective from management educators. Int. J. Manage. Educ.